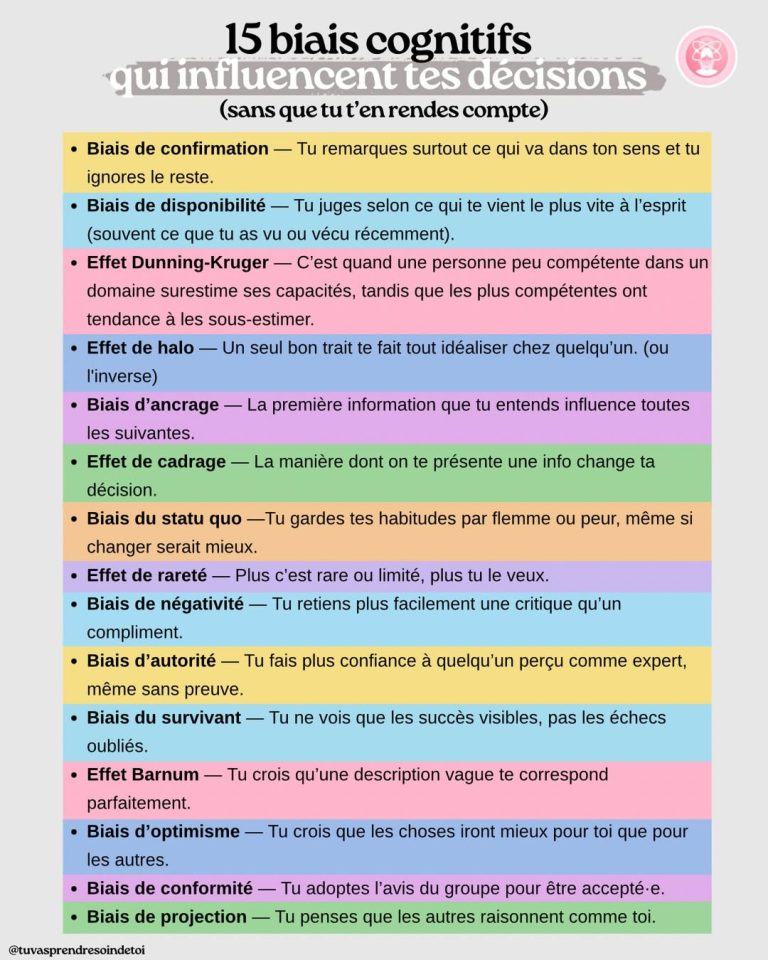

15 biais cognitifs qui influencent tes décisions — sans que tu t'en rendes compte

Ton cerveau prend des raccourcis. Tout le temps. Ce n'est pas un défaut — c'est ce qui te permet de fonctionner sans être paralysé(e) par chaque micro-décision. Mais certains de ces raccourcis te jouent des tours — dans tes relations, ton travail, ta façon de voir le monde. Voici 15 d'entre eux, expliqués concrètement et sans jargon.

- Biais de confirmation — tu vois ce que tu veux voir

- Biais de disponibilité — tu juges selon ce qui te vient facilement en tête

- Effet Dunning-Kruger — moins on sait, plus on est sûr

- Effet de halo — un bon trait efface tout le reste

- Biais d'ancrage — la première info écrase les suivantes

- Effet de cadrage — la forme change le fond

- Biais du statu quo — changer fait peur, même quand c'est mieux

- Effet de rareté — l'inaccessible attire

- Biais de négativité — le négatif pèse plus que le positif

- Biais d'autorité — l'habit fait le moine

- Biais du survivant — tu ne vois que ce qui a réussi

- Effet Barnum — tu te reconnais partout

- Biais d'optimisme — tu crois être à l'abri

- Biais de conformité — le groupe pense, tu suis

- Biais de projection — tu penses que les autres te ressemblent

Avant de commencer Pourquoi ton cerveau a des biais — et pourquoi ce n'est pas une insulte

Un biais cognitif n'est pas un signe d'intelligence médiocre. C'est un signe que ton cerveau fonctionne normalement. Le cerveau humain traite environ 11 millions d'informations par seconde — mais notre conscience n'en gère que 40 à 50. Pour combler cet écart colossal, il utilise des raccourcis mentaux appelés heuristiques. Les biais cognitifs sont les effets secondaires inévitables de ces raccourcis.

En clair : les biais cognitifs sont des erreurs systématiques de jugement, prévisibles, communes à tous les êtres humains, indépendamment de l'intelligence ou de l'éducation. Daniel Kahneman, prix Nobel d'économie, a passé des décennies à documenter comment même les experts les plus brillants y sont soumis.

Connaître ses biais ne les fait pas disparaître. Mais ça crée une distance utile — un moment de lucidité dans lequel on peut se demander : "Est-ce que je pense vraiment ça, ou est-ce que mon cerveau prend un raccourci ?"

C'est ça, l'objectif de cet article. Pas te rendre paranoïaque de ta propre pensée. Te rendre un peu plus libre à l'intérieur d'elle.

Le biais de l'angle mort : le biais qui consiste à croire qu'on est moins sujet aux biais que les autres. Il a un nom. Et en te disant "moi je connais déjà ces biais, ça ne me concerne pas vraiment" — tu es peut-être en train de l'activer en ce moment.

On ne cherche pas vraiment la vérité. On cherche la confirmation de ce qu'on croit déjà. Le biais de confirmation, c'est la tendance à rechercher, retenir et interpréter les informations de façon à valider ses croyances existantes — et à minimiser ou ignorer tout ce qui les contredit.

Tu es convaincu(e) que ton collègue ne t'aime pas. Quand il ne te salue pas un matin — preuve. Quand il rit à une de tes blagues — exception, il fait semblant. Tu as une théorie, et tu construis des preuves autour d'elle plutôt que de remettre la théorie en question.

Même chose en politique, en santé, dans une dispute en couple : on lit les articles qui confirment, on skipe ceux qui nuancent.

Le signal : tu te sens systématiquement conforté(e) dans tes opinions. Tu n'entends presque jamais d'argument qui te fait vraiment changer d'avis. Tout ce que tu lis semble confirmer ce que tu pensais déjà.

Cherche activement le contre-argument le plus solide qui existe contre ta position. Pas pour te convaincre qu'il a raison — mais pour t'assurer que ta conviction tient vraiment face à lui. Si tu ne peux pas formuler l'argument adverse, tu ne comprends peut-être pas encore vraiment le sujet.

Décrit dès 1960 par le psychologue Peter Wason dans sa célèbre "tâche de sélection", et approfondi par les travaux de Kahneman sur la pensée intuitive. Les algorithmes des réseaux sociaux amplifient massivement ce biais en ne te montrant que ce avec quoi tu t'es déjà engagé(e).

Pour évaluer la probabilité d'un événement, ton cerveau ne fait pas de statistiques. Il cherche des exemples en mémoire — et plus un exemple vient facilement, plus il lui semble probable. Ce qui est vivace en mémoire paraît fréquent. Ce qui est abstrait paraît rare.

Après un reportage sur un accident d'avion, tu trouves l'avion plus dangereux que la voiture — alors que la voiture tue statistiquement 100 fois plus. L'accident d'avion est spectaculaire, médiatisé, mémorable. L'accident de voiture est banal — donc il semble moins grave.

Même chose : tu entends parler de deux ou trois personnes qui ont réussi en dropshipping — et tu surestime les chances de réussite dans ce domaine.

Le signal : tu bases une décision importante sur des exemples que tu as récemment vus ou entendus, sans chercher de données plus larges. Ta perception du risque ou de la fréquence d'un événement varie selon ce que tu as vu dans les médias cette semaine.

Avant de juger la probabilité d'un événement, cherche des données réelles — pas des anecdotes. Demande-toi : "Est-ce que ce cas me vient facilement à l'esprit parce qu'il est fréquent, ou parce qu'il est frappant ?" Ce sont deux choses très différentes.

Identifié par Amos Tversky et Daniel Kahneman en 1973. L'une des découvertes fondatrices de la psychologie comportementale — elle a montré que les humains évaluent les probabilités non pas par le calcul mais par la facilité de rappel mémoriel.

Les personnes peu compétentes dans un domaine ont tendance à surestimer leurs capacités — parce qu'elles n'ont pas encore les outils pour mesurer ce qu'elles ne savent pas. À l'inverse, les plus compétentes sous-estiment souvent les leurs — parce qu'elles voient la complexité du domaine et tout ce qui leur échappe encore.

Quelqu'un qui a regardé trois documentaires sur la nutrition va parfois avoir des opinions plus tranchées qu'un nutritionniste diplômé — lequel sait à quel point les données sont complexes et contradictoires. Le débutant ne voit pas encore les limites de son savoir.

En entreprise : le stagiaire qui "sait exactement ce qu'il faudrait changer", et le directeur de 20 ans d'expérience qui reste prudent dans ses certitudes.

Le signal : tu as des opinions très fermes sur un sujet que tu n'as étudié que superficiellement. Tu te sens irrité(e) par les nuances que les experts avancent — elles te semblent des compliqutions inutiles.

Cultive le "je ne sais pas" comme une réponse légitime et précieuse. Plus tu avances dans un domaine, plus les certitudes absolues deviennent rares. Si tu n'as jamais de doutes sur un sujet complexe, c'est peut-être que tu n'es pas encore assez avancé(e) pour voir les zones d'ombre.

Décrit en 1999 par les psychologues David Dunning et Justin Kruger dans une étude restée célèbre. Ils ont montré que les participants les moins performants à des tests surestimaient leurs résultats de façon systématique — et que les plus performants les sous-estimaient.

L'effet de halo désigne la tendance à laisser une caractéristique positive (ou négative) d'une personne colorer l'ensemble de notre jugement sur elle. Un seul attribut rayonne — comme un halo — sur tout le reste, même sur des aspects sans rapport.

Tu rencontres quelqu'un d'attirant physiquement — et tu lui trouves automatiquement plus de charme, d'intelligence, de fiabilité. Ou quelqu'un parle avec assurance et éloquence, et tu lui accordes une expertise qu'il n'a peut-être pas.

L'effet inverse existe aussi : on appelle ça l'effet de cornes. Une première impression négative teinte tout ce qui suit — le moindre défaut confirme l'ensemble.

Le signal : tu trouves qu'une personne a "tout pour elle" ou "tout contre elle" — sans jamais identifier de trait neutre ou contradictoire. Tout semble cohérent dans un seul sens.

Évalue les traits indépendamment les uns des autres. Est-ce que cette personne est compétente dans ce domaine précis — indépendamment de ce que tu penses d'elle par ailleurs ? Le fait qu'elle soit sympathique ne dit rien de sa fiabilité dans ce projet.

Décrit pour la première fois par le psychologue Edward Thorndike en 1920 dans une étude sur les évaluations militaires. Il remarqua que les officiers évalués comme physiquement bien bâtis se voyaient aussi attribuer de meilleures qualités intellectuelles et morales — sans lien objectif.

La première information reçue sur un sujet sert d'ancre — un point de référence autour duquel toutes les évaluations suivantes s'organisent. Même quand l'ancre est arbitraire, elle influence le jugement de façon significative et difficile à corriger.

Un article "barré" à 199 € soldé à 89 € semble une affaire — même si l'article ne valait jamais vraiment 199 €. C'est l'ancre du prix initial qui crée la perception d'économie.

En négociation salariale : celui qui annonce un chiffre en premier ancre la discussion. Si tu demandes 38 000 € et que tu aurais accepté 33 000 €, tu as perdu 5 000 € par manque d'ancrage.

Le signal : tu évalues quelque chose en te référant systématiquement à un premier chiffre ou une première information reçue, sans t'interroger sur sa pertinence réelle comme point de départ.

Avant toute négociation ou évaluation, définis ta propre référence indépendante. Quelle est la valeur réelle de cet objet, de ce salaire, de cette offre — sans tenir compte du chiffre qu'on t'a donné en premier ? Reconnaître l'ancre, c'est déjà réduire son emprise.

Découvert par Tversky et Kahneman en 1974. Dans leur expérience classique, des participants faisaient tourner une roue biaisée (10 ou 65), puis estimaient le pourcentage de pays africains à l'ONU. Ceux qui avaient vu 65 donnaient des estimations systématiquement plus élevées — la roue, pourtant sans rapport, servait d'ancre.

Deux formulations qui véhiculent exactement la même information peuvent mener à des décisions opposées — simplement parce que l'une met en avant le gain, l'autre la perte. Le cerveau ne traite pas l'information brute : il traite la façon dont elle est présentée.

"Ce traitement a 90 % de chances de réussir" et "Ce traitement a 10 % de risque d'échec" — c'est identique mathématiquement. Mais la première formulation génère bien plus d'acceptation que la seconde. Des études médicales l'ont documenté chez des patients et chez des médecins.

Même chose : "bœuf haché à 80 % maigre" vs "bœuf haché à 20 % de matière grasse". Identique. Impression très différente.

Le signal : tu réagis fortement à une formulation — enthousiaste ou rebuté(e) — sans t'être demandé(e) si une formulation différente de la même réalité changerait ton ressenti.

Reformule systématiquement l'information dans le sens opposé. Si on te dit "95 % de satisfaction", demande-toi ce que représente les 5 %. Si on te présente une opportunité sous l'angle du gain, cherche activement les risques. Changer le cadre change la perception.

Démontré par Kahneman et Tversky dans leur théorie des perspectives (1979), qui leur valut le prix Nobel. Leur découverte centrale : les pertes font psychologiquement environ deux fois plus mal que les gains équivalents ne font plaisir — ce qui rend le cadrage en perte ou en gain particulièrement puissant.

Toutes choses égales par ailleurs, on préfère la situation actuelle à une situation différente — même quand les données objectives suggèrent que changer serait préférable. Le statu quo est connu, prévisible, et donc perçu comme plus sûr. Le changement représente une perte potentielle, et on est plus sensibles aux pertes qu'aux gains.

Tu restes dans un emploi qui ne te convient plus parce que "c'est stable". Tu continues une relation qui ne t'épanouit plus parce que "c'est connu". Tu gardes ton opérateur téléphonique trop cher parce que "changer, c'est compliqué". Dans chaque cas, l'inaction est un choix — juste un choix invisible.

Le signal : tu justifies l'inaction par des arguments vagues ("c'est comme ça", "on verra plus tard", "c'est compliqué") sans avoir vraiment évalué les alternatives. La question "et si je changeais ?" génère une anxiété disproportionnée au risque réel.

Inverse la charge de la preuve. Au lieu de te demander "pourquoi changer ?", demande-toi "pourquoi rester ?" — et exige de cette réponse la même rigueur que tu demanderais au changement. L'inaction n'est pas neutre. Elle a aussi des coûts.

Formalisé par les économistes William Samuelson et Richard Zeckhauser en 1988. Étroitement lié à l'aversion aux pertes de Kahneman : puisqu'on ressent les pertes plus intensément que les gains équivalents, toute situation actuelle — même imparfaite — a l'avantage d'éviter la perte potentielle liée au changement.

La valeur perçue d'une chose augmente dès qu'elle semble rare, limitée ou en voie de disparaître. Ce n'est pas rationnel — mais c'est cohérent avec une logique évolutive : les ressources rares méritaient davantage d'attention. Le problème, c'est que ce mécanisme s'applique même quand la rareté est artificielle.

"Plus que 2 en stock." "Offre valable jusqu'à ce soir minuit." "Édition limitée." Ces formules ne décrivent pas toujours une réalité — elles créent une urgence qui court-circuite la réflexion et pousse à agir avant d'avoir vraiment réfléchi.

En relation : quelqu'un qui se fait rare ou difficile d'accès paraît souvent plus désirable — non pas parce qu'il est meilleur, mais parce que l'accessibilité réduite active ce biais.

Le signal : tu ressens une urgence soudaine à acquérir ou à agir dès qu'on mentionne une limite de temps, de quantité ou d'accès. La peur de manquer (FOMO) prend le dessus sur le raisonnement.

Pose-toi une seule question : "Est-ce que je voulais vraiment ça avant d'apprendre que c'était limité ?" Si non — l'urgence est fabriquée. Laisse passer 24h. Si l'offre disparaît et que tu n'es pas soulagé(e) de ne pas l'avoir prise, tu en avais peut-être vraiment besoin. Sinon, tu viens d'économiser de l'argent ou de l'énergie.

Étudié par le psychologue Robert Cialdini dans son ouvrage fondamental sur l'influence (1984). Il l'identifie comme l'un des six principes universels de la persuasion. Les études montrent que même quand les gens savent qu'une rareté est artificielle, ils continuent de valoriser davantage l'objet "limité".

Les informations négatives ont un poids psychologique plus important que les informations positives de même intensité. Une critique reste plus longtemps en mémoire, affecte plus fortement l'humeur, et influence davantage les décisions qu'un compliment équivalent. Le cerveau traite le négatif en priorité — parce que dans l'histoire de l'espèce, rater une menace coûtait la vie. Rater une opportunité, non.

Tu reçois 9 retours positifs sur une présentation et un commentaire critique. Tu rentreras chez toi en pensant au commentaire critique. Tu auras du mal à te souvenir des 9 retours positifs avec la même précision.

En couple : une phrase blessante dite dans une dispute peut effacer des semaines de tendresse dans la mémoire émotionnelle. Il faut environ 5 interactions positives pour "compenser" une interaction négative — c'est le ratio de Gottman.

Le signal : après une situation mixte (feedback, événement, journée), tu te souviens surtout des parties négatives. Tu as du mal à "encaisser" une critique même constructive, même bienveillante.

Compense délibérément ce biais en notant activement le positif — pas parce que c'est du "positif toxique", mais parce que ton cerveau le sous-pondère automatiquement. Un journal de gratitude n'est pas naïf — c'est un correctif neurologique à un biais évolutif.

Documenté par Paul Rozin et Edward Royzman en 2001 et confirmé par des dizaines d'études depuis. Les neurosciences montrent que les stimuli négatifs activent l'amygdale plus rapidement et plus intensément que les stimuli positifs — et génèrent des souvenirs plus durables et plus détaillés.

On accorde automatiquement plus de crédibilité à quelqu'un qui projette une image d'autorité — titre, uniforme, ton assuré, présence médiatique, nombre d'abonnés. Ce mécanisme nous permet de nous appuyer sur le savoir des autres sans tout vérifier — ce qui est utile 80 % du temps. Mais il peut aussi nous amener à suivre des "experts" dont le titre ou la confiance n'a rien à voir avec leur compétence réelle dans le domaine en question.

Un médecin qui donne des conseils nutritionnels n'est pas forcément plus qualifié qu'un nutritionniste — mais son titre crée une autorité perçue. Un influenceur avec 2 millions d'abonnés qui parle d'investissement n'a pas nécessairement de compétences financières réelles.

L'expérience de Milgram (1961) a montré l'extrême de ce biais : des participants ordinaires administraient des chocs électriques à d'autres personnes simplement parce qu'un homme en blouse blanche leur demandait de continuer.

Le signal : tu acceptes une affirmation sans la questionner parce que c'est quelqu'un de "reconnu" qui la fait. Ou à l'inverse, tu rejettes un argument solide parce qu'il vient de quelqu'un sans statut.

Sépare l'autorité du domaine. Un chirurgien est une autorité en chirurgie — pas nécessairement en nutrition, en finance ou en politique. Demande-toi toujours : "Cette personne est-elle compétente dans ce domaine précis — ou je lui fais confiance parce qu'elle a l'air de savoir ?"

Formalisé par Stanley Milgram dans ses expériences sur l'obéissance à l'autorité (1961-1963). Cialdini l'a identifié comme l'un des six piliers de la persuasion. L'industrie publicitaire l'utilise massivement : blouses blanches, titres ronflants, recommandations d'"experts".

On ne tire des leçons que des cas qu'on voit — et on ne voit que les cas qui ont "survécu" à un processus de sélection : les succès sont visibles, médiatisés, célébrés. Les échecs sont invisibles, tus, oubliés. On construit alors des théories sur le succès à partir d'un échantillon radicalement biaisé.

"Untel a réussi sans diplôme, donc les diplômes ne servent à rien." Mais on ne voit pas les milliers de personnes qui ont tenté la même chose et qui n'ont pas réussi — elles ne font pas la une.

Pendant la Seconde Guerre mondiale, l'armée américaine voulait blindé les zones des avions qui revenaient trouées. Le statisticien Abraham Wald leur montra que c'était l'erreur inverse : les zones intactes sur les avions revenus étaient celles qui touchées avaient fait s'écraser les autres — ceux qu'on ne voyait plus.

Le signal : tu bases une conclusion sur des exemples de succès sans t'interroger sur la proportion d'échecs invisibles. "Beaucoup de gens ont réussi avec cette méthode" — combien ont essayé et échoué silencieusement ?

Cherche activement les données sur les échecs, pas seulement sur les succès. Avant de t'inspirer d'un modèle de réussite, demande-toi : "Combien de personnes ont fait exactement la même chose et ont disparu des radars ?" La réponse change souvent l'analyse.

Le terme a été popularisé par l'analyse d'Abraham Wald pendant la Seconde Guerre mondiale, mais le concept est appliqué dans tous les domaines : finance, médecine, entrepreneuriat. Dans les études cliniques, le biais du survivant est l'une des menaces les plus sérieuses à la validité des conclusions.

Nous avons tendance à accepter des descriptions de personnalité vagues et générales comme si elles nous correspondaient précisément — surtout quand elles sont présentées comme personnalisées ou issues d'une analyse de nous-mêmes. Ce phénomène explique en grande partie la popularité de l'astrologie, de certains tests de personnalité et des prédictions de voyants.

"Tu as parfois besoin de te retrouver seul(e) pour recharger tes batteries, mais tu apprécies aussi les moments en compagnie des autres." Cette phrase décrit environ 100 % de la population humaine — et pourtant elle donne l'impression d'un portrait intime et précis.

Les horoscopes, le MBTI, l'ennéagramme, les descriptions de chakras : tous s'appuient en partie sur des formulations suffisamment générales pour que chacun s'y retrouve — et l'attribue à l'outil plutôt qu'à la généralité.

Le signal : tu lis une description (de ton signe astrologique, de ton profil de personnalité) et tu penses "c'est exactement moi" — sans t'être demandé(e) si une autre description t'aurait tout autant convenu.

Teste la spécificité : si on te donnait la description du signe ou du profil opposé au tien, t'y retrouverais-tu aussi ? Souvent, la réponse est oui — ce qui dit quelque chose sur la généralité des descriptions, pas sur ta singularité.

Nommé d'après le showman P.T. Barnum, et formalisé par le psychologue Bertram Forer en 1948. Il avait fait passer un test de personnalité à ses étudiants, donné à chacun le même texte générique — et recueilli une note moyenne de 4,26/5 en termes de précision perçue.

La très grande majorité des gens se croient plus malins, plus sains et plus chanceux que la moyenne — ce qui est mathématiquement impossible. On tend à surestimer ses chances de succès, à sous-estimer les risques qui nous concernent personnellement, et à croire que les mauvaises statistiques s'appliquent aux autres plus qu'à soi.

Presque tout le monde pense conduire mieux que la moyenne. La plupart des entrepreneurs estiment que leur entreprise a plus de chances de réussir que les statistiques du secteur. On lit "1 fumeur sur 2 développe une maladie grave" et on pense "pas moi".

Le biais d'optimisme est aussi à l'origine de la "planification irréaliste" : on sous-estime systématiquement le temps, l'argent et les obstacles nécessaires pour mener un projet à bien.

Le signal : tes estimations de temps et de coûts pour tes projets sont régulièrement dépassées. Tu as du mal à imaginer que quelque chose de grave puisse vraiment t'arriver à toi personnellement.

Applique le "pre-mortem" de Gary Klein : avant de lancer un projet, imagine qu'il a échoué dans un an. Qu'est-ce qui s'est passé ? Quels obstacles as-tu sous-estimé ? Cette projection volontaire vers l'échec contre-balance l'optimisme non fondé sans détruire la motivation.

Étudié par Tali Sharot (University College London), qui a montré avec l'imagerie cérébrale que le cerveau traite les informations positives sur l'avenir différemment des informations négatives — en intégrant mieux les premières dans ses prévisions. Ce biais aurait une valeur adaptative : l'optimisme soutient la persévérance. Mais il a un coût en termes de préparation aux risques réels.

Face à une incertitude, on se fie souvent à ce que les autres font ou pensent comme signal de ce qu'il faut faire. C'est la preuve sociale. Et même quand on est certain(e) de son opinion, la pression du groupe peut faire vaciller cette certitude — pas par conviction, mais par peur de l'exclusion ou du conflit.

Dans une réunion, tu es convaincu(e) qu'une idée est mauvaise — mais quand tout le monde autour de la table semble acquiescer, tu te tais, voire tu acquiesces toi aussi. "Pensée de groupe" (groupthink) en entreprise, pression dans un cercle d'amis, vote pour le candidat "qui a des chances" plutôt que celui en qui tu crois.

Le signal : tu remarques a posteriori que tu t'es tu(e) ou que tu as changé de position dans un groupe — non pas parce qu'un argument t'a convaincu(e), mais parce que la pression sociale était trop forte. Ou tu te souviens d'avoir fait quelque chose uniquement "parce que tout le monde le faisait".

Avant d'exprimer ton opinion dans un groupe, formule-la clairement dans ta tête (ou par écrit). Ça la rend moins perméable à la pression externe. Et rappelle-toi : le consensus de groupe est une information sociale, pas une preuve de vérité.

Étudié par Solomon Asch dans ses expériences de conformité (1951) : des participants normaux, entourés d'acteurs donnant des réponses visiblement fausses, les imitaient dans 37 % des cas — même quand la bonne réponse était évidente. La peur du jugement social est suffisamment forte pour déformer la perception.

On tend à projeter ses propres états intérieurs, valeurs, motivations et façons de raisonner sur les autres — en supposant implicitement qu'ils fonctionnent comme nous. Ce n'est pas de l'égocentrisme conscient : c'est la façon dont le cerveau modélise les autres, en utilisant soi-même comme référence par défaut.

Tu es quelqu'un qui a besoin qu'on lui dise explicitement les choses — et tu interprètes le silence de quelqu'un d'autre comme de l'accord, parce que toi tu te tairais si tu n'étais pas d'accord. Tu aimes recevoir des cadeaux comme marque d'amour — et tu offres des cadeaux à tout le monde sans réaliser que leur langage de l'amour est différent.

En management : "Si c'était moi, je saurais trouver la solution tout seul" — et donc on ne donne pas d'explications suffisantes à l'équipe.

Le signal : tu te retrouves souvent surpris(e) ou blessé(e) que quelqu'un n'ait pas réagi comme tu l'aurais fait. Ou tu te dis "si j'étais à sa place, j'aurais..." — et tu oublies que lui ou elle n'est précisément pas à ta place.

Remplace l'hypothèse par la question. Plutôt que de supposer que l'autre ressent ou pense comme toi — demande. "Comment tu vis ça ?" "De quoi tu as besoin là ?" Ce sont des questions simples qui court-circuitent la projection et ouvrent une communication réelle.

Décrit par Freud sous le terme de "projection" dans un sens défensif, puis étudié plus largement en psychologie sociale comme un mécanisme ordinaire de modélisation d'autrui. Les neurosciences ont identifié le réseau du mode par défaut (DMN) comme la structure cérébrale impliquée dans cette simulation mentale des autres — et elle utilise effectivement nos propres représentations comme matériau de base.

Les 15 biais — en un coup d'œil

- 🔴Confirmation : tu cherches ce qui valide ce que tu crois déjà.

- 🔴Disponibilité : ce qui te vient facilement en tête te semble plus probable qu'il ne l'est.

- 🔴Dunning-Kruger : les débutants sur-confiant, les experts prudents. Tu n'y échappes pas non plus.

- 🔴Effet de halo : un trait positif rayonne sur tout. Un trait négatif aussi — c'est l'effet de cornes.

- 🔴Ancrage : la première info prise place en référence. Tout le reste s'organise autour.

- 🔴Cadrage : la même réalité présentée différemment mène à des décisions opposées.

- 🔴Statu quo : l'inaction est un choix invisible. Et souvent le plus coûteux.

- 🔴Rareté : "limité" = désirable. L'urgence fabriquée court-circuite la réflexion.

- 🔴Négativité : une critique pèse environ deux fois plus qu'un compliment. Compense délibérément.

- 🔴Autorité : le titre et le ton créent une crédibilité souvent sans lien avec la compétence réelle.

- 🔴Survivant : tu ne vois que ce qui a réussi. Les échecs silencieux biaisent toute leçon de succès.

- 🔴Barnum : les descriptions vagues semblent précises parce qu'elles s'appliquent à tout le monde.

- 🔴Optimisme : tu surestimes tes chances. Les mauvaises statistiques concernent les autres — jusqu'à ce qu'elles te concernent.

- 🔴Conformité : le consensus n'est pas une preuve. Et te taire n'est pas être neutre.

- 🔴Projection : les autres ne pensent pas comme toi. Demande plutôt que de supposer.

Questions fréquentes

Connaître ses biais suffit-il à s'en défaire ?

Non — et c'est l'une des conclusions les plus solides de la recherche sur ce sujet. Même les chercheurs qui étudient les biais toute leur vie les expérimentent. La connaissance crée une distance utile, pas une immunité. Ce qu'elle permet : dans les situations importantes, faire une pause délibérée et se demander "quel biais pourrait opérer là ?" — ce qui augmente les chances de décision plus lucide. Dans les décisions automatiques du quotidien, en revanche, les biais continuent de fonctionner.

Certains biais peuvent-ils être utiles ?

Oui — la plupart ont une fonction adaptative. Le biais d'optimisme soutient la persévérance face aux obstacles. Le biais de conformité réduit les conflits et facilite la coopération sociale. La négativité augmentée a protégé nos ancêtres des prédateurs. Ces mécanismes ne sont pas des erreurs de conception — ce sont des solutions à des problèmes évolutifs anciens qui créent des effets secondaires dans notre environnement moderne très différent.

Comment développer un jugement plus lucide au quotidien ?

Quelques pratiques concrètes : cherche systématiquement le contre-argument le plus fort contre ta position. Prends tes décisions importantes par écrit plutôt qu'en réaction. Ajoute du temps entre l'impulsion et l'action. Consulte des personnes qui te contredisent réellement, pas celles qui valident. Et reviens régulièrement sur tes décisions passées pour identifier les biais qui y ont joué — non pour te culpabiliser, mais pour calibrer ta pensée future.

Lequel de ces 15 biais est le plus important à connaître ?

Difficile d'en choisir un — mais si c'était le cas : le biais de confirmation, parce qu'il opère à l'amont de tout le reste. Une fois qu'une croyance est installée, il filtre l'information qui vient alimenter tous les autres biais. En apprenant à chercher activement ce qui contredit tes croyances plutôt que ce qui les confirme, tu crées les conditions d'une pensée plus libre sur l'ensemble.

Tu veux aller plus loin dans la connaissance de toi-même ?

Nos formations t'accompagnent pour mieux comprendre tes schémas de pensée, tes réactions automatiques — et te donner de vrais outils pour y travailler.

Découvrir les formations →